刚和“亲戚”视频完就被骗 当心!长沙已有人遭遇AI换脸诈骗

长沙晚报掌上长沙5月25日讯(全媒体记者 邓艳红)近期,“AI换脸”新型诈骗在多地上演,这种利用AI技术和声音合成手段进行的诈骗,迷惑性极强,诈骗成功率相当高。这不,长沙一市民就被这种诈骗手段骗走了2000元。

“我刚刚讲完AI换脸诈骗的手段和防范方法,就有市民跟我说,她的哥哥被这种诈骗手段骗了……”近日,湖南省最美公益普法个人、雨花公安分局民警刘杰讲述了一起发生在身边的AI换脸诈骗案例,提醒市民不要上当。

和“亲戚”视频通话后,他被骗2000元

刘杰告诉记者,他近日受邀到雨花区洞井街道上反诈课,告诉市民什么是AI换脸诈骗及如何预防,课后,听课的一企业负责人彭女士对刘杰说,她哥哥最近被骗了2000元,骗子使用的诈骗手法正是刘杰在课中所讲的AI换脸诈骗。

彭女士介绍,她哥哥彭先生最近遇到一位“亲戚”添加其微信,随后,对方一直以彭先生亲戚的口吻和他进行文字聊天。聊天了几分钟后,该“亲戚”问彭先生能不能帮忙购买彩票,并且发了一个购买彩票的链接过来,还说中奖率很高。彭先生一看购买彩票竟然需要2000元,为了慎重起见,他便拨通了微信语音电话,邀请“亲戚”语音聊天,对方却接连两次拒绝语音聊天。就在彭先生以为对方肯定是冒充的时候,“亲戚”却主动发来了微信视频通话请求,彭先生接通视频聊天后,看到视频中的人确实是“亲戚”的相貌,声音也比较像,但视频聊天仅接通了几秒,对方便以信号不好为由挂断了通话。

彭先生以为已经和对方视频通话确认过了,便不再怀疑,于是便点开了对方提供的所谓内部链接,购买了2000元的彩票,后来彩票没有中奖,彭先生事后拨打亲戚电话,才知道这位亲戚根本没有要他买彩票,自己被骗了。

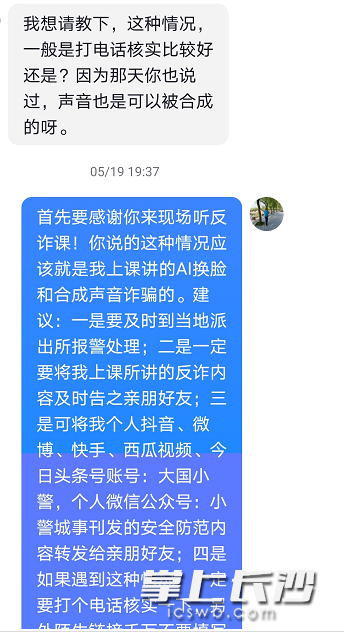

听完彭女士讲完哥哥的被骗过程,刘杰告诉她“这就是我上课所讲的AI换脸和合成声音诈骗”,并建议彭女士赶紧让哥哥去报警。

防范AI换脸诈骗,要做好以下几点

记者了解到,AI诈骗常用手法包括声音合成和AI换脸等。声音合成即骗子通过骚扰电话录音等来提取某人声音,获取素材后进行声音合成,从而可以用伪造的声音骗过对方;AI换脸则更具迷惑性,骗子首先获取市民头像等个人信息,根据所要实施的骗术,通过AI技术筛选目标人群。在视频通话中利用AI换脸,骗取信任。

刘杰介绍说,新型AI视频换脸诈骗迷惑性极强,诈骗成功率接近100%。“很多没有上当的人觉得自己不会被骗,那不是因为你有多聪明,也不是因为你没钱,而是适合你的‘剧本’还在路上……”刘杰提醒,对这种新型诈骗一定要引起足够的警惕。

如何防范AI换脸诈骗呢?刘杰提醒,应做好以下几点:

一是要保护好个人信息,避免诱惑。不要轻易透露自己的身份证、银行卡、验证码等信息,不要轻易提供人脸、指纹等个人生物信息给他人,不过度公开或分享动图、视频等,不随便接听陌生人电话;

二是要多重验证,确认身份。如果有人自称“熟人”“领导”等通过社交软件、短信以各种理由诱导汇款,或涉及网络转账交易行为时,务必通过电话、见面等多途径核验对方身份,不要未经核实随意转账汇款;

三是要提高警惕,注意防范。公检法没有安全账户,警察不会网上办案,如果有网络警察说你犯事了,让他联系你当地的派出所,你也可以主动打110咨询;如不慎被骗或遇可疑情形,请注意保护证据立即拨打96110报警。

>>我要举报